Bài viết này sẽ phân tích chi tiết sự khác biệt giữa GPT-5.4 với Opus 4.7 trên các khía cạnh quan trọng như lập trình (coding), agentic workflows và xử lý ngữ cảnh dài, đồng thời đánh giá dựa trên các benchmark thực tế, cấu trúc giá và khả năng sử dụng công cụ. Qua đó, giúp bạn lựa chọn mô hình AI phù hợp nhất với nhu cầu phát triển phần mềm và tự động hóa công việc.

Tổng quan nhanh về GPT-5.4 với Opus 4.7

GPT-5.4 ra mắt ngày 5 tháng 3 năm 2026, là mô hình flagship của OpenAI dành cho công việc chuyên nghiệp, hợp nhất khả năng coding và suy luận vào một mô hình đa năng duy nhất. Sáu tuần sau, ngày 16 tháng 4, Anthropic phát hành Claude Opus 4.7 với chiến lược khác biệt: một mô hình có khả năng xử lý công việc kỹ thuật dài hạn một cách tự chủ và duy trì sự mạch lạc xuyên suốt các phiên làm việc dài mà hầu hết các agent khác dễ bị “vỡ”.

GPT-5.4 là mô hình frontier mới nhất của OpenAI, hợp nhất hai dòng Codex và GPT thành một hệ thống duy nhất. Mô hình này sở hữu cửa sổ ngữ cảnh hơn 1 triệu token (922K đầu vào, 128K đầu ra), hỗ trợ cả văn bản và hình ảnh, cho phép suy luận trên ngữ cảnh dài, lập trình và phân tích đa phương thức trong cùng một quy trình làm việc.

Mô hình mang lại hiệu suất vượt trội trong các lĩnh vực như lập trình, hiểu tài liệu, sử dụng công cụ và tuân thủ hướng dẫn. GPT-5.4 được thiết kế như một lựa chọn mặc định mạnh mẽ cho cả tác vụ đa năng lẫn kỹ thuật phần mềm, có khả năng tạo ra mã nguồn đạt chất lượng production, tổng hợp thông tin từ nhiều nguồn và thực thi các quy trình nhiều bước phức tạp với ít lần lặp hơn, đồng thời tối ưu hiệu quả sử dụng token.

Opus 4.7 là thế hệ tiếp theo trong dòng Opus của Anthropic, được xây dựng dành cho các tác nhân (agent) hoạt động dài hạn và bất đồng bộ. Kế thừa thế mạnh về lập trình và agentic từ Opus 4.6, phiên bản này mang lại hiệu suất cao hơn trong các tác vụ phức tạp, nhiều bước và khả năng thực thi agent ổn định hơn trong các quy trình kéo dài. Đặc biệt, Opus 4.7 rất hiệu quả cho các pipeline agent bất đồng bộ, nơi các tác vụ diễn ra theo thời gian – như làm việc với codebase lớn, debug nhiều giai đoạn và điều phối dự án end-to-end.

Ngoài lập trình, Opus 4.7 còn cải thiện mạnh mẽ khả năng xử lý công việc tri thức – từ soạn thảo tài liệu, xây dựng bài thuyết trình đến phân tích dữ liệu. Mô hình duy trì sự nhất quán trong các đầu ra rất dài và các phiên làm việc kéo dài, khiến nó trở thành lựa chọn mặc định mạnh mẽ cho những tác vụ đòi hỏi tính liên tục, khả năng đánh giá và theo sát đến cùng.

Đối với người dùng nâng cấp từ các phiên bản Opus trước, vui lòng tham khảo hướng dẫn chuyển đổi chính thức.

So sánh trực tiếp GPT-5.4 với Opus 4.7

Dưới đây là bảng tóm tắt nhanh trước khi đi sâu vào từng khía cạnh.

| Tiêu chí | GPT-5.4 | Opus 4.7 |

|---|---|---|

| Total Context | 1.05M | 1M |

| Max Output | 128K | 128K |

| Độ trễ | 1,89s | 1,72s |

| Throughput | 44tps | 50tps |

Định vị mô hình và mục đích sử dụng

OpenAI định vị GPT-5.4 là mô hình đa năng thống nhất. Nó hấp thụ toàn bộ khả năng coding trước đây thuộc về GPT-5.3-Codex, nên lập trình viên không còn cần chuyển request giữa các endpoint khác nhau tùy theo loại nhiệm vụ. Một mô hình, một endpoint, cho mọi công việc.

Lời giới thiệu của Anthropic về Opus 4.7 hẹp hơn: một mô hình được tối ưu hóa cho “lập trình, tác nhân, sử dụng máy tính và quy trình làm việc doanh nghiệp”, với khả năng tự chủ lâu dài là điểm khác biệt chính. Bạn giao phó công việc kỹ thuật khó khăn và tin tưởng nó sẽ tự phát hiện lỗi trước khi báo cáo lại.

Cần lưu ý rằng Opus 4.7 là mô hình có khả năng nhất hiện có của Anthropic, nhưng không phải là tốt nhất; Claude Mythos Preview nằm trên nó, chỉ dành riêng cho các quy trình an ninh mạng phòng thủ.

Sự khác biệt đó thể hiện rõ nhất ở những trường hợp cực đoan: các phiên lập trình kéo dài rất lâu, hoặc các quy trình kết nối hàng chục công cụ với nhau.

Coding và agentic workflows

Về coding ở mức repository, Opus 4.7 dẫn đầu trên các benchmark mà mỗi nhà cung cấp chọn báo cáo (chi tiết bên dưới). Nó giới thiệu cơ chế tự kiểm tra output (self-output verification), nghĩa là mô hình tự kiểm tra công việc của mình trước khi trả về. Genspark đặc biệt nhấn mạnh khả năng chống loop: Opus 4.7 ít bị kẹt trong vòng lặp vô tận trên một vấn đề hơn.

GPT-5.4 dẫn đầu Terminal-Bench 2.0 với khoảng 6 điểm (75.1% so với 69.4%), dù Anthropic lưu ý rằng con số này đến từ harness tự báo cáo của OpenAI. GPT-5.4 cũng giới thiệu Interactive Thinking – cho phép điều chỉnh kế hoạch giữa chừng trong quá trình suy luận phức tạp. Opus 4.7 chưa có tính năng tương đương.

Khoảng cách trên SWE-bench là có thật, dù chỉ 6 điểm trên benchmark do nhà cung cấp chọn vẫn chỉ là tín hiệu tham khảo chứ chưa phải kết luận.

Cửa sổ ngữ cảnh và công việc ngữ cảnh dài

Cả hai mô hình đều hỗ trợ khoảng 1 triệu tokens. Điểm khác biệt nằm ở chi phí khi sử dụng toàn bộ ngữ cảnh đó. Opus 4.7 áp dụng mức giá cố định (flat rate) trên toàn bộ cửa sổ, nên một request 900K tokens có chi phí mỗi token giống như request 9K tokens. GPT-5.4 tính $2.50 mỗi triệu tokens dưới ngưỡng 272K input, nhưng vượt ngưỡng này thì toàn bộ phiên sẽ bị tính giá cao hơn.

Tôi sẽ trình bày số liệu chính xác ở phần giá cả.

Ngoài ra còn có thay đổi về tokenizer: Opus 4.7 có thể map cùng một đoạn văn bản thành nhiều hơn tới 35% số token so với phiên bản 4.6. Giá mỗi token không đổi, nhưng chi phí thực tế cho mỗi nhiệm vụ có thể tăng.

Về hiệu suất ngữ cảnh dài thực tế, các thử nghiệm từ đối tác cho thấy Opus 4.7 đạt điểm nhất quán cao nhất (0.715) trên sáu module nghiên cứu. Các pipeline RAG lấp đầy gần 1 triệu tokens nên được kiểm tra trên workload thực tế trước khi dựa hoàn toàn vào benchmark của nhà cung cấp.

Sử dụng công cụ, đa phương thức và tương tác môi trường

Bề mặt công cụ trông tương đồng trên giấy tờ nhưng khác biệt rõ hơn khi sử dụng thực tế. Trên OSWorld-Verified (sử dụng máy tính để bàn), Opus 4.7 dẫn trước với 78.0% so với 75.0% của GPT-5.4, cả hai đều vượt mức chuyên gia con người (72.4%). Ngược lại, trên nghiên cứu web dựa trên trình duyệt, GPT-5.4 đạt 89.3% trên BrowseComp (phiên bản Pro) so với 79.3% của Opus 4.7. Một tiêu đề “computer use” duy nhất đã che giấu sự khác biệt giữa desktop và browser.

Nâng cấp đa phương thức nổi bật của Opus 4.7 là độ phân giải hình ảnh: xử lý ảnh lên đến 2.576 pixel cạnh dài (khoảng 3.75 megapixel), gấp hơn 3 lần so với các mô hình Claude trước, và được xử lý tự động với độ trung thực cao hơn mà không cần tham số API. Đối tác kiểm tra bảo mật XBOW báo cáo độ sắc nét thị giác tăng vọt từ 54.5% trên Opus 4.6 lên 98.5% trên 4.7 – mức cải thiện lớn nhất trong một benchmark đơn lẻ của lần ra mắt này.

Hai mô hình cũng khác nhau về kiến trúc công cụ. GPT-5.4 tải định nghĩa công cụ theo nhu cầu thay vì nhúng hết vào prompt, giúp giảm chi phí token trong hệ sinh thái công cụ lớn. Opus 4.7 suy nghĩ qua vấn đề trước khi gọi công cụ, nên sử dụng ít cuộc gọi công cụ hơn tổng thể; số lượng tool call chỉ tăng ở mức effort cao.

Khả năng điều hướng (steerability), độ tin cậy và phong cách output

Opus 4.7 thực hiện lệnh theo nghĩa đen. Nó không suy diễn từ một mục sang mục khác hay đoán yêu cầu bạn chưa nêu, nên các prompt viết cho 4.6 đôi khi hoạt động không như mong đợi; Anthropic khuyên nên tinh chỉnh lại. Điểm lợi là độ tin cậy cao hơn trong các vòng agentic dài: đội ngũ kỹ thuật của Ramp cho biết cần ít hướng dẫn từng bước hơn trong workflow đa công cụ, và thử nghiệm của Hexagon cho thấy Opus 4.7 ở mức effort thấp tương đương Opus 4.6 ở mức trung bình.

Anthropic cũng giới thiệu mức effort mới xhigh nằm giữa high và max, đồng thời nâng mức mặc định của Claude Code lên xhigh cho tất cả gói. Kết hợp với tokenizer mới, số token output có thể cao hơn so với 4.6 ở các lượt agentic sau. Task Budgets (đang beta công khai) cho phép bạn giới hạn chi tiêu token của agent trong một phiên.

Với GPT-5.4, câu chuyện steerability tập trung vào Interactive Thinking (đã đề cập ở phần coding), và hướng dẫn prompt của OpenAI cho biết mô hình hoạt động tốt khi có “output contract” rõ ràng.

Một ghi chú từ đánh giá an toàn của chính Anthropic: Opus 4.7 cải thiện về tính trung thực và khả năng chống prompt injection so với 4.6, nhưng hơi giảm khả năng từ chối lời khuyên chi tiết về việc giảm hại với chất kiểm soát. Đánh giá tổng thể của Anthropic: “phần lớn phù hợp và đáng tin cậy, dù chưa phải là lý tưởng hoàn hảo về hành vi.”

So sánh GPT-5.4 với Opus 4.7 trong các bài kiểm tra hiệu năng

Các bài kiểm tra hiệu năng rất đáng để xem xét kỹ lưỡng, nhưng chỉ nên tin tưởng đến một mức độ nhất định. Cả hai nhà cung cấp đều chọn những bài kiểm tra hiệu năng có lợi cho họ, và Vals.ai cùng Artificial Analysis vẫn chưa lập chỉ mục Opus 4.7 tại thời điểm bài viết này được thực hiện. Hãy tự mình kiểm tra trên các tác vụ của riêng bạn trước khi đưa ra bất kỳ kết luận nào từ những kết quả này.

Benchmark coding

Bảng dưới đây bao gồm các bằng chứng coding liên quan nhất từ tài liệu ra mắt của mỗi bên.

| Benchmark | Claude Opus 4.7 | GPT-5.4 | Ghi chú |

|---|---|---|---|

| SWE-bench Pro | 64.3% | 57.7% | Vendor-reported; cấu hình harness khác nhau |

| SWE-bench Verified | 87.6% | Chưa công bố | OpenAI chưa công bố điểm chính thức trên variant này |

| CursorBench | ~70% | Chưa công bố | Cursor là đối tác của Anthropic; không độc lập |

| Terminal-Bench 2.0 | 69.4% | 75.1% | Anthropic lưu ý điểm của GPT-5.4 từ harness tự báo cáo; GPT-5.4 giảm so với GPT-5.3-Codex (77.3%) |

| GPQA Diamond | 94.2% | 94.4% (Pro) | Gần như hòa; mức bão hòa cao |

SWE-bench có nhiều variant và cả hai bên đều nhấn mạnh variant mà họ làm tốt nhất. Anthropic đã áp dụng bộ lọc memorization và cho biết khoảng cách của Opus 4.7 vẫn giữ được sau khi loại trừ các vấn đề bị flag.

Benchmark agent và computer-use

Với việc ra mắt Opus 4.7, Anthropic công bố số liệu so sánh hai mô hình trên hầu hết benchmark agentic. Kết quả khá cân bằng chứ không nghiêng hẳn về một bên.

| Benchmark | Claude Opus 4.7 | GPT-5.4 | Ghi chú |

|---|---|---|---|

| OSWorld-Verified | 78.0% | 75.0% | Sử dụng máy tính để bàn; cả hai vượt baseline chuyên gia con người 72.4% |

| BrowseComp | 79.3% | 89.3% (Pro) | Nghiên cứu web với multi-hop reasoning; GPT-5.4 dẫn trước |

| MCP-Atlas | 77.3% | 68.1% | Sử dụng tool quy mô lớn qua nhiều dịch vụ kết nối |

| WebArena-Verified | Chưa công bố | 67.3% | Nhiệm vụ điều hướng web tự chủ |

| Toolathlon | Chưa công bố | 54.6% | Orchestration tool đa bước; tăng từ 46.3% trên GPT-5.2 |

| Finance Agent v1.1 | 64.4% | 61.5% (Pro) | Agent nghiên cứu tài chính ngữ cảnh dài |

| GDPval-AA | 1753 Elo | 1674 Elo | Công việc kiến thức chuyên nghiệp; Opus 4.7 dẫn 79 Elo |

| BigLaw Bench | 90.9% (high effort) | Chưa công bố | Nhiệm vụ tài liệu pháp lý; đánh giá từ đối tác Harvey |

Kết quả chia theo môi trường: Opus 4.7 thắng trên desktop, tool use và knowledge work; GPT-5.4 thắng trên nghiên cứu browser. Nhiều số liệu của GPT-5.4 đến từ variant Pro, nên phiên bản tiêu chuẩn có thể thấp hơn. Các chạy độc lập trên cùng scaffold sẽ là bước tiếp theo.

Claude Opus 4.7 có tốt hơn GPT-5.4 không?

Không có câu trả lời chung cho tất cả, và bất kỳ bài viết nào khẳng định có một câu trả lời duy nhất đều đang bán thứ gì đó.

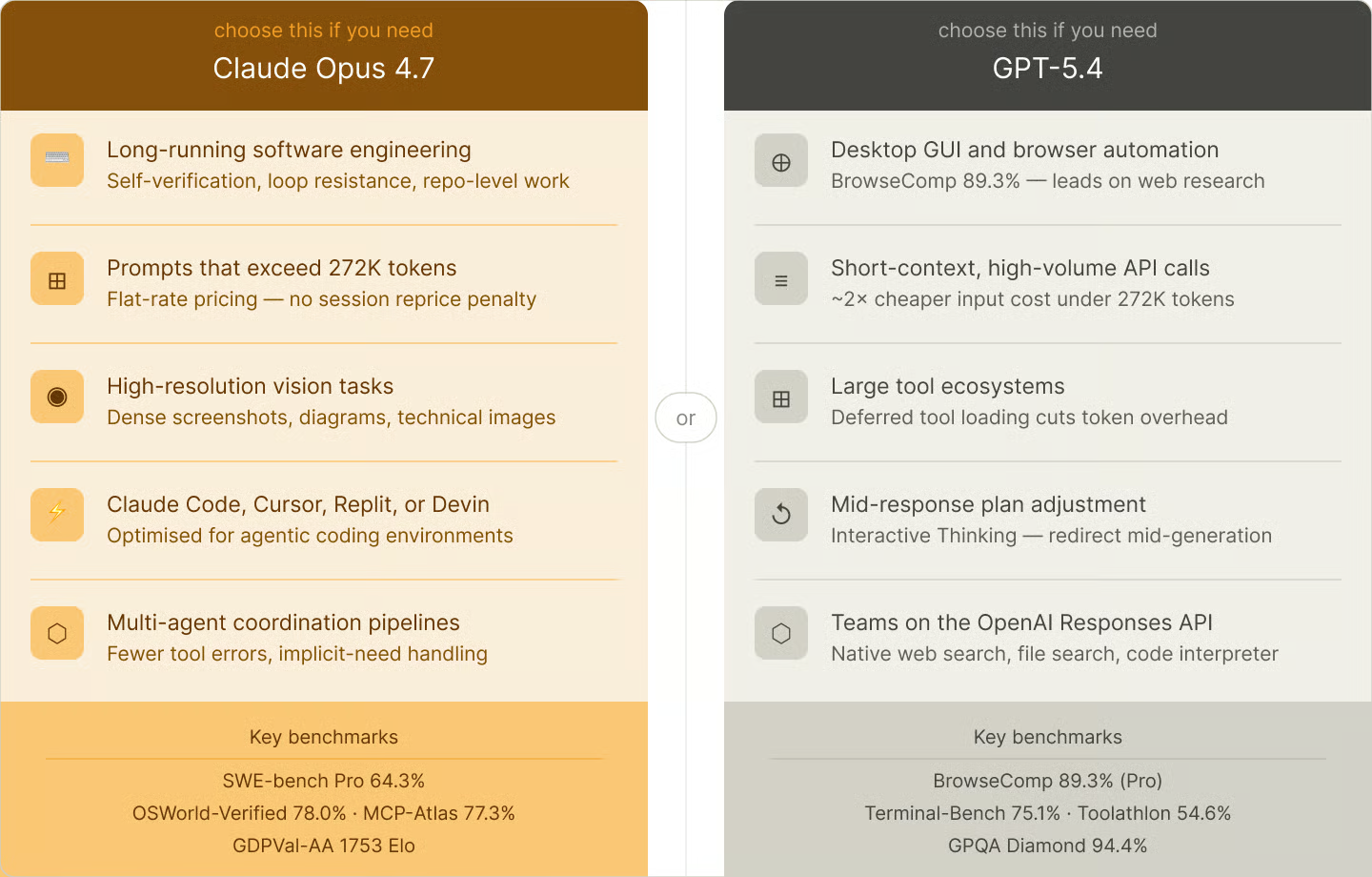

Chọn Claude Opus 4.7 nếu công việc chính của bạn là:

- Software engineering dài hạn mà cần tự kiểm tra output

- Agent hoạt động trên ứng dụng desktop

- Prompt thường xuyên vượt 272K tokens

- Workflow đọc screenshot dày đặc hoặc sơ đồ kỹ thuật

- Bạn đã dùng Claude Code, Cursor, Replit hoặc Devin

Chọn GPT-5.4 nếu:

- Agent của bạn làm nghiên cứu web dựa trên browser nặng

- Workload chủ yếu dưới 272K tokens và chi phí là yếu tố quan trọng

- Bạn cần deferred tool loading trong hệ sinh thái công cụ lớn

- Đội ngũ đã dùng OpenAI Responses API

Hãy cân nhắc thử cả hai nếu công việc của bạn bao gồm cả nghiên cứu web tự động và lập trình dài hơi. Thế mạnh về trình duyệt và thiết bị đầu cuối của GPT-5.4 phù hợp với quy trình làm việc web tự động; khả năng chống lỗi vòng lặp và giá cố định của Opus 4.7 hoạt động tốt hơn cho các phiên kỹ thuật chuyên sâu và các quy trình xử lý tài liệu phức tạp.

Kết luận

Sự khác biệt giữa Claude Opus 4.7 và GPT-5.4 không nằm ở việc mô hình nào thông minh hơn mà nằm ở hình thức công việc bạn đang thực hiện.

Anthropic đặt cược vào tự chủ: một mô hình được xây dựng để duy trì sự mạch lạc qua các phiên engineering dài và tự kiểm tra output. OpenAI đặt cược vào độ rộng: bề mặt công cụ rộng hơn và mức giá rẻ hơn cho đa số prompt dưới 272K tokens.